Met emotieherkenning slaan we de plank ethisch mis, erkent Microsoft

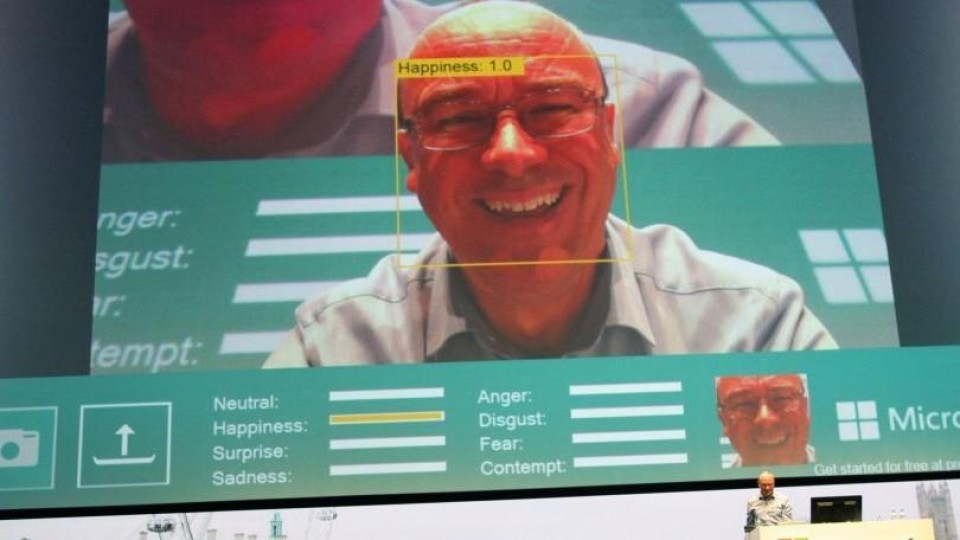

Microsoft introduceerde de 'emotion tool' in 1995 als een van de successen van de inzet van machineleraning-technieken. Maar al snel kreeg het gebruik ervan forse kritiek onder meer vanuit wetenschappelijke hoek. Iemand kan een frons op het gezicht hebben, maar dat betekent nog niet dat diegene ook kwaad is, verklaarde bijvoorbeeld psychologie-hoogleraar Lisa Felman Barrett in 2019 tegenover The Verge. Het is onwetenschappelijk om een link te leggen tussen gezichtsuitdrukkingen en emoties.

Bovendien gaat de tool uit van de aanname dat gezchtsuitdrukkingen universeel zijn en daarmee gaat deze voorbij aan cultuurgebonden verschillen, een klassiek voorbeeld van een techniek die is ontworpen door witte techneuten die zichzelf tot de universele standaard verheffen.

Richting prullenbak

Microsoft volgt nu adviezen op die zijn voortgekomen uit een proces van herevaluatie van het ethische beleid bij het bedrijf. Dat proces is in 2019 gestart. Het gevolg is dat de emotieherkenning sinds gisteren niet meer beschikbaar is voor nieuwe gebruikers van Azure Face. Terugkerende gebruikers kunnen de controversiële onderdelen blijven gebruiken tot 30 juni 2023.

Microsoft het gebruik van andere onderdelen van de gezichtsherkenning aan striktere regels gebonden. Zo moeten gebruikers steeds nauwkeurig omschrijven waar ze een bepaalde functie voor willen gebruiken. Onderdelen waarmee bijvoorbeeld automatisch gezichten kunnen worden vervaagd (blurring) blijven gewoon eenvoudig toegankelijk. Maar ook de onderdelen waarmee automatisch aan gezichten labels als 'geslacht' (gender) leeftijd, gezichtsbeharing, haar en make-up kunnen worden gehangen, worden uitgefaseerd.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee