AI van Google Lens-camera herkent nu één miljard objecten

De techgigant kondigde Lens in mei 2017 aan op zijn ontwikkelaarsconferentie I/O. Enkele maanden later verscheen de technologie in de Foto’s-app van Google (Android en iOS) om informatie te geven over gefotografeerde objecten. Kort daarna integreerde Google de Lens-feature ook in zijn digitale spraakbutler Assistent op nieuwere Android-smartphones. Dit jaar is Lens tevens uitgekomen als losse Android-app en is de techniek beschikbaar in Googles iOS-app.

Druk je in de Assistant-app op het Lens-icoontje dan kan je de camera richten op een object waar je meer over wil weten. Dat kan een product in de winkel zijn, maar bijvoorbeeld ook een dier, bekender gebouw of bloem of plant. Lens vertelt dan onder andere om wat voor plant het gaat en waar je hem (mogelijk) kan kopen.

Lens wordt steeds slimmer

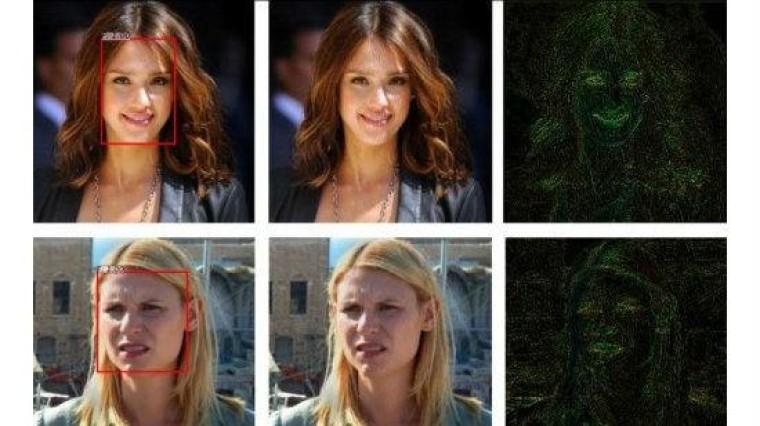

In een jaar tijd is de optische objectherkenning-technologie achter Lens een stuk slimmer geworden, legt Google uit in een blogpost. Het aantal objecten dat de AI snapt, is toegenomen van 250 duizend naar ruim één miljard. Dat is vierduizend keer zoveel en komt omdat de AI verschillende vormen van machine learning en computer vision gebruikt om zijn algoritmen te verbeteren en kennis te vergroten. Lens wordt bijvoorbeeld gevoed door honderden miljoenen beelden uit Google Afbeeldingen, Google’s Knowledge Graph (met tientallen miljarden feiten) en TensorFlow, het opensource machine learning framework van Google. De AI analyseert ook data van smartphonefoto’s.

Door deze technieken te combineren, is Lens in relatief korte tijd veel slimmer en veelzijdiger geworden. De cameratool kon je telefoon al automatisch met een Wi-Fi netwerk verbinden door een foto te maken van de Wi-Fi code of het routerlabel. Inmiddels kan Lens ook de teksten van recepten en bonnetjes lezen en kopiëren. En informatie van een visitekaartje wordt gebruikt om een Google-contactpersoon te maken.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee