AI gaat cybersecurity op z'n kop zetten, waarschuwt TNO

- Kunstmatige intelligentie is niet langer een SF-onderwerp.

- Ook cybersecurity wordt flink geraakt door AI.

- TNO en banken hebben PurpleAI-project opgezet.

- Lees ook: AI-hype en -wedloop leiden tot run op GPU-chips

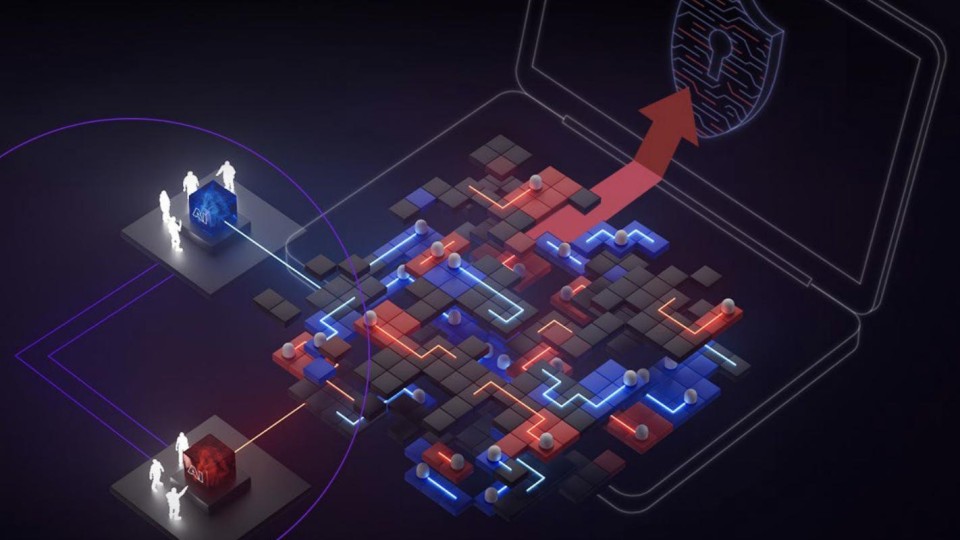

Inzet van kunstmatige intelligentie kan veel voordelen geven voor cybersecurity, door AI dan zowel redteaming als blueteaming te laten doen. Dus aanvallen én verdedigen van de eigen infrastructuur van een bedrijf of organisatie. Onderzoeksinstituut TNO heeft hier onderzoek naar gedaan en daarbij zogeheten PurpleAI ontwikkeld, samen met financiële bedrijven.

AI is jarenlang belicht in sciencefictionboeken en -films waarin kunstmatige intelligentie ver in de toekomst leek te liggen, schrijft TNO in een vandaag gepubliceerde onderzoekspaper. Die toekomst is echter nu en de praktijk wordt daardoor heel anders. De publieke release van AI-bot ChatGPT heeft veel verandering gebracht, op vele gebieden. Cybersecurity is één van die gebieden, die nu wordt belicht in de TNO-paper.

Offensief en defensief nut

Het Nederlandse onderzoeksinstituut waarschuwt dat AI het cybersecuritylandschap gaat verstoren. Offensieve AI heeft de potentie om kwaadwillenden te laten scannen op kwetsbaarheden, om hogere rechten te verkrijgen, om zijdelings (lateral) te bewegen in ICT-omgevingen, en om andere soorten hackaanvallen uit te voeren via binary-bestanden en Powershell-commando's. En dat op snelheden die ver voorbij de grenzen van menselijk reactievermogen gaan, aldus TNO.

"Het is dus essentieel dat Red Teams dezelfde technologische mogelijkheden en expertise hebben om AI-gebaseerde aanvallen te simuleren", adviseren de auteurs van de paper 'PCSI paper PurpleAI' (van de Partnership for Cyber Security Innovation). Die publiek-private samenwerking telt onder de kernleden de banken ABN AMRO en ING plus financieel dienstverlener Achmea. Die drie bedrijven hebben samen met de Volksbank en TNO het PurpleAI-project opgezet.

AI-aanvallen al in de praktijk

De kleur paars komt van de combinatie van rood (Red Team, ethische hackers die aanvallen) en blauw (Blue Team, verdedigers). "Het gebruik van AI voor defensieve doeleinden is net zo onmisbaar [als voor offensieve inzet - red.]", schrijft TNO. Blue Teams moeten begrijpen hoe aanvallen op basis van machine learning en AI werken, en hoe ze dan de verdediging van hun ICT-infrastructuur kunnen automatiseren, aldus de onderzoekers.

In het PCSI-project PurpleAI is geëxperimenteerd met het gebruik van AI-technologie. Dus voor aanvallen én voor verdedigen. Méér gebruik van AI voor cybersecurity is noodzakelijk, luidt één van de conclusies hieruit. Een groep experts van de PCSI-kernleden is namelijk unaniem van mening dat aanvallers nu in de praktijk al AI inzetten voor specifieke taken. De vraag is nog wel of - en wanneer - kwaadwillenden hackaanvallen in de nabije toekomst kunnen inzetten die volledig autonoom worden uitgevoerd.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee