Hoge AI-kosten en Nvidia-dominantie krijgen tegengas van Microsoft en AMD

Nvidia dankt zijn dominantie op AI-gebied niet alleen aan zijn hardware, maar ook aan software: de CUDA-libraries die de facto industriestandaard zijn geworden. De Compute Unified Device Architecture (CUDA) is een technologie waarmee grafische processors (GPU's) direct zijn aan te spreken en te benutten voor meer algemene doeleinden, in plaats van slechts beeldweergave.

Niet op één paard wedden

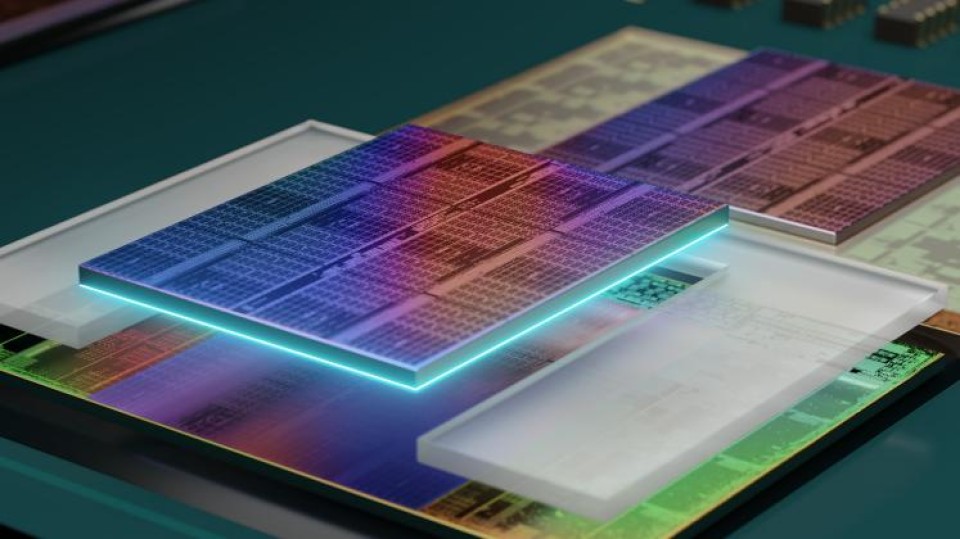

Microsoft gebruikt in zijn Azure-datacenters al enkele tienduizenden GPU's van Nvidia, waarmee het eind vorig jaar een AI-gerichte supercomputerconfiguratie ging samenstellen. Nu komt naar buiten dat Microsoft het niet alleen bij de grote GPU-maker zoekt, maar ook juist bij de kleinere concurrent AMD. Daarmee werkt de aanbieder van cloud- en AI-diensten samen, zo melden ingewijde bronnen aan persbureau Bloomberg.

GPU-maker AMD zou daarbij steun en mankracht van Microsoft-ingenieurs krijgen, om zijn chips te verbeteren voor AI-toepassingen. Microsoft ontwikkelt onder de codenaam Athena al een eigen accelerator-chip voor AI, wat in april bekend is geworden. Volgens Bloomberg is AMD daarbij betrokken, maar Ars Technica meldt dat Microsoft dit tegenspreekt.

Prijspressie en zakelijk gebruik

Ongeacht wat de AI-samenwerking tussen Microsoft en AMD precies omvat, kan het druk uitoefenen op het marktdominante Nvidia en op de kosten voor het trainen en draaien van AI-toepassingen. De benodigde aantallen krachtige GPU's plus het opschalen van datasets kunnen voor hoge prijskaartjes zorgen.

Dit geldt ook voor AI-applicaties die voor afgeschermd gebruik door bedrijven zijn. Daarbij blijven dan bedrijfsgeheimen en -data gegarandeerd intern en is trainingsdata puur afkomstig van die gebruikende organisatie zelf. Laatstgenoemde komt in theorie de betrouwbaarheid van het AI-gebruik ten goede en zou zogeheten AI-hallucinaties moeten voorkomen.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee