Nieuw, sneller open source AI-model legt de lat hoger

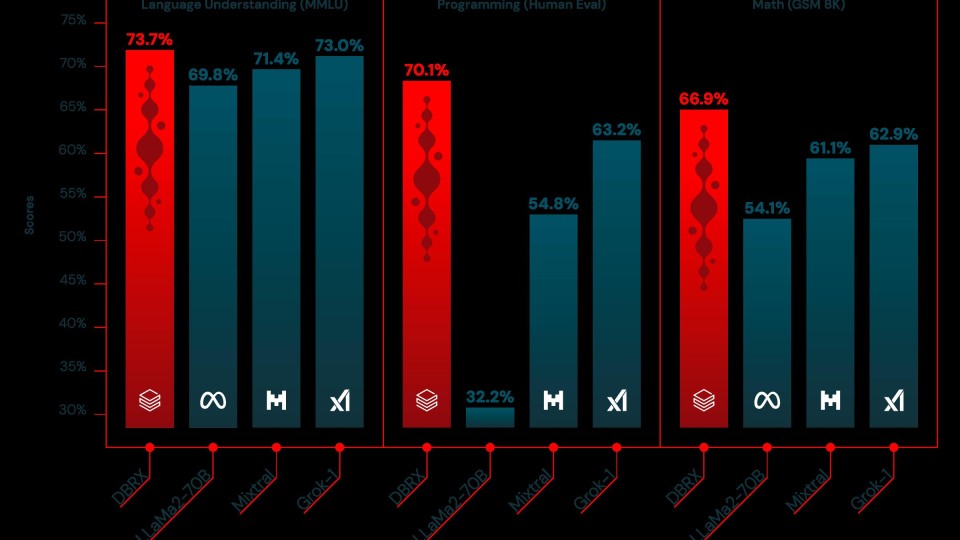

De opensourcewereld is een large language model (LLM) rijker dat volgens de maker ervan een nieuw record neerzet qua prestatieniveau. LLM DBRX van Databricks overtroeft "alle andere bestaande open source-modellen" in AI-benchmarktesten op het gebied van taal, wiskunde en logica.

De prestatievergelijking is uitgevoerd met onder meer Llama 2 70B van Facebook-moederbedrijf Meta en Mixtral-8x7B van het Franse AI-bedrijf Mistral. Laatstgenoemde is recent omarmd door techreus Microsoft, die tot voor kort juist exclusief voor de GPT-technologie van OpenAI leek te gaan.

Beter, beetje beter

De voorsprong die leverancier Databricks claimt voor zijn nieuwe LLM DBRX is in sommige gevallen groot, maar niet in alle gevallen. Zo is het flink beter in de test voor programmeren (HumanEval), maar nipt beter dan de concurrentie in de benchmark voor taalbegrip (MMLU).

Naast de vergelijking met andere opensource AI-modellen is DBRX ook aan de tand gevoeld versus GPT-3.5 van OpenAI. In taalbegrip is het nieuwe opensource AI-model wat beter, in wiskunde (GSM8K) een stuk beter en in programmeren (HumanEval) aanmerkelijk beter.

Gratis download en details

DBRX is vrijelijk beschikbaar op ontwikkelplatform GitHub en bij AI-community Hugging Face. Het AI-model is ontwikkeld door Mosaic AI die in een blogpost technische details deelt over de modelevaluatie en de uitgevoerde prestatiebenchmarks.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee